近日,我室杨必胜教授课题组在遥感一区顶刊ISPRS Journal of Photogrammetry and Remote Sensing发表题为“Look at the whole scene: General point cloud place recognition by classification proxy”的学术论文。论文的第一作者是实验室硕士研究生谢越,共同第一作者为香港理工大学王冰老师,通讯作者为实验室梁福逊助理研究员。

课题组创新性地提出了一种分类代理点云定位识别框架LAWS(Look at the whole scene),通过全面观察整个场景进行点云特征提取。该方法的核心是空间分割设计,旨在提供整体场景监督,确保全面学习场景特征。为了消除单一正交分割边界带来的潜在模糊性,特别设计了一种对角线再分割机制来消除分类不确定性。在增强的分割机制下,空间被划分为多个类别和组。此外,为防止不同组之间的知识遗忘,采用了一种特殊的训练策略,使得每个组的训练独立进行。设计实验验证LAWS的通用性,实验数据涵盖了室内外环境和不同任务,并包含各种未知环境和传感器模式来测试其泛化能力。实验结果表明,LAWS在Oxford RobotCar、MulRan和KITTI等多个数据集上的表现均优于现有方法,展示了更高的召回率和F1得分,且在未知环境中的泛化能力显著提升。

位置识别是一项利用图像和点云等视觉输入准确识别出先前访问过的地点的任务,可以视作在地图中的快速粗定位,在自动驾驶、机器人导航、SLAM等领域有着广泛的应用。在现有的位置识别方案中,大部分研究依赖于成本高昂的负样本挖掘来提供监督信号,这种检索式训练存在着跨场景、跨传感器、跨时域泛化性不足的问题。同时,它们对可扩展性以及模型持续学习能力的研究不足。针对这些问题,课题组提出了一种纵观全局(Look at the whole scene,LAWS)的训练方法,广泛用于多种场景与任务下的点云位置识别任务。

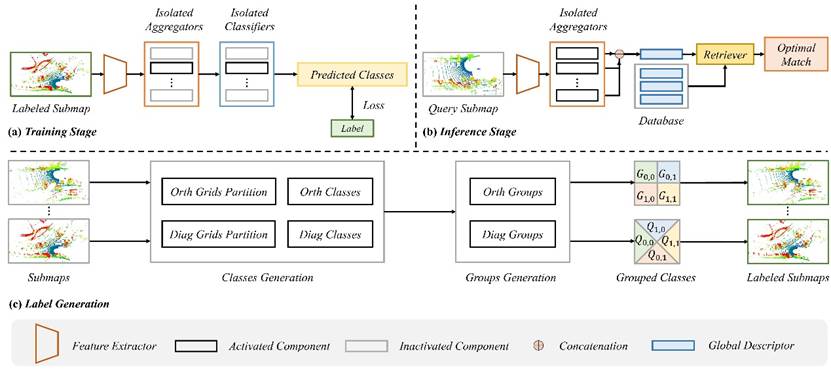

课题组提出的LAWS以地理空间分类为中心思想重新构建了位置识别的训练模式,首先,以正交和对角的方式对地理空间进行离散化,并进一步将类别划分为组别,生成了端到端地理分类训练的监督信号,其次,采用孤立聚合器的训练策略确保模型最大程度地学习各个地理类别与组别,最后,在推理阶段回归到检索模式,保证在未知空间的可泛化性。

图1 LAWS方法流程图

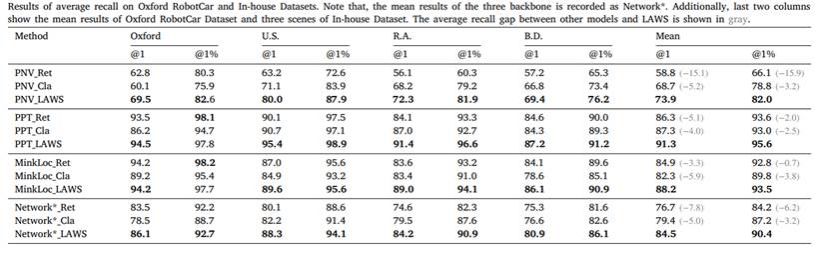

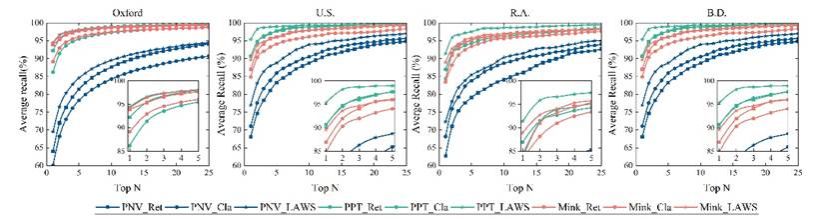

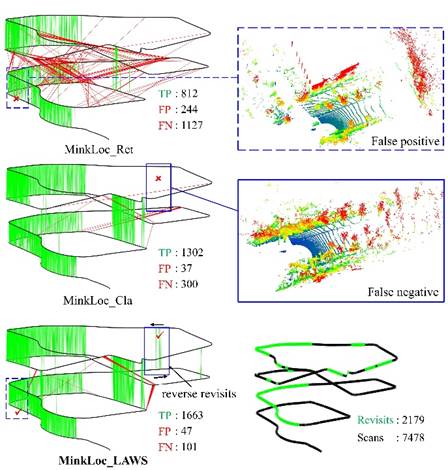

课题组在Oxford RobotCar、MulRan、KITTI等公开数据集上基于精度、泛化性、效率等评价指标测试了所提出方法的整体性能。在Oxford RobotCar以及Inhouse(U.S./R.A./B.D.)共四个测试区域展现出90.4%的平均重定位召回率,与对比方法相比提升6.2%和3.2%;在MulRan和KITTI数据集共10条序列上进行回环检测取得了95.1和89.1的𝐹1分数;在室内数据集ScannetPR上达到68.1%的召回率。

表1 LAWS与对比方法在Oxford和Inhouse上的平均召回率

图2 LAWS与对比方法在Oxford和Inhouse上的平均召回率变化曲线

图3 MulRan DCC 02序列上的回环检测可视化

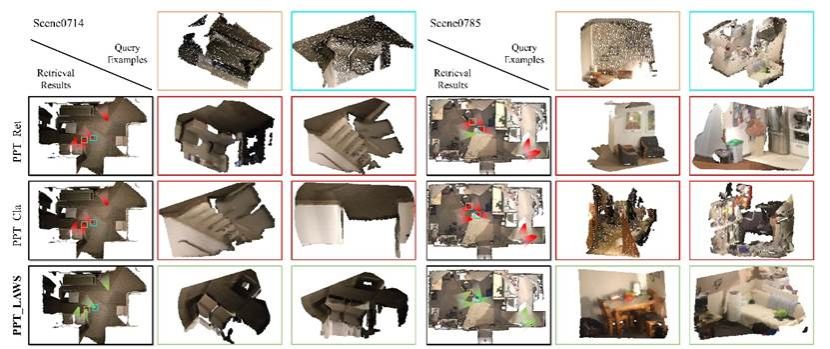

图4 ScannetPR上的正确与错误可视化案例

LAWS主要围绕分类思想对现有位置识别训练方式进行优化。首先,提出多种互补的划分方案以支持尽可能平滑且连续地对地理空间进行离散化。为了进一步增强方法的稳健性,采用了独特的孤立训练策略,以规避地理组别在切换过程中发生的知识遗忘。利用各种室内和室外数据集进行了多种实验,结果表明,与现有方法相比,LAWS具有优秀的通用性,其显著的泛化能力和可扩展性使其能够很好适应各种未知环境和传感器配置。

论文链接:

https://www.sciencedirect.com/science/article/pii/S0924271624002557

代码链接(代码开源):

https://github.com/BrusonX/LAWS

课题组网站:

https://3s.whu.edu.cn/ybs/index.htm

武大空间智能研究所二维码: